Le décret oblige les entreprises développant des modèles d’IA à transmettre leurs résultats de tests de sécurité. Ce texte constitue une première tentative de régulation du secteur de l’intelligence artificielle aux Etats-Unis, à défaut de pouvoir voter une loi plus ambitieuse pour le moment.

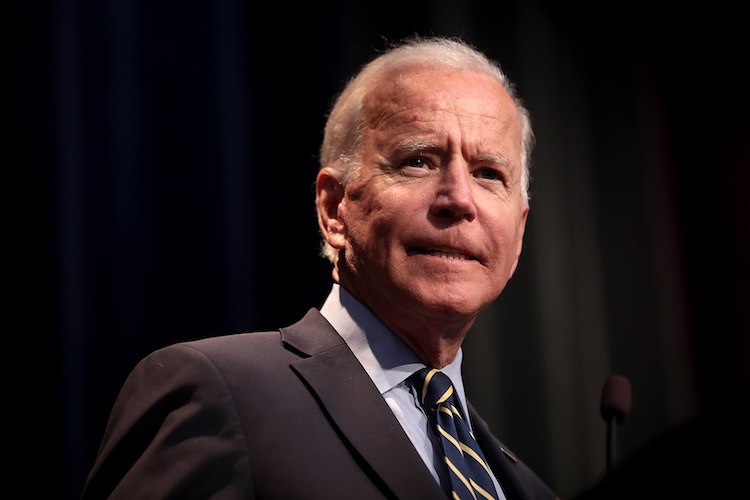

Les Etats-Unis empruntent-ils un peu à l’Union européenne dans leur approche de l’IA ? L’Oncle Sam joue la carte de la réglementation avec un décret signé de la main du président démocrate Joe Biden et qui impose aux entreprises travaillant au développement de modèles d’IA, telles que Google ou Open AI, de partager leurs résultats de tests en matière de sécurité.

« Pour réaliser les promesses de l’IA et éviter les risques, nous devons gouverner cette technologie », a déclaré le président au moment de la signature du décret devant des élus, membres du gouvernement et représentants de l’industrie.

Les résultats de ces tests devront être transmis lorsque des projets présentent « un risque sérieux en termes de sécurité nationale, de sécurité économique nationale, ou de santé publique ». Les critères de tests seront établis au niveau fédéral.

Une réglementation qui se heurte au Congrès

Le décret évoque également la création de mécanismes visant à éviter les biais discriminatoires de l’IA, à lancer des recherches sur l’impact de l’intelligence artificielle sur le marché du travail ainsi que des outils pour identifier les contenus produits avec de l’IA.

Ce décret apparaît cependant comme un petit lot de consolation pour les partisans d’une réglementation de l’IA. Car en pratique, sans un texte voté par le Congrès américain il est difficile de voir aboutir une réglementation réellement ambitieuse et contraignante. Or, celui-ci, en plus d'être à majorité républicaine, est paralysé par des dissensions au sein même des républicains divisés entre les soutiens de Donald Trump et les autres.